부스트캠프 AI Tech 1기 [T1209 최보미]/U stage

Day16 학습정리 - NLP1

B1001101

2021. 2. 15. 23:57

강의 복습

1. Intro to NLP, Bag-of-Words

더보기

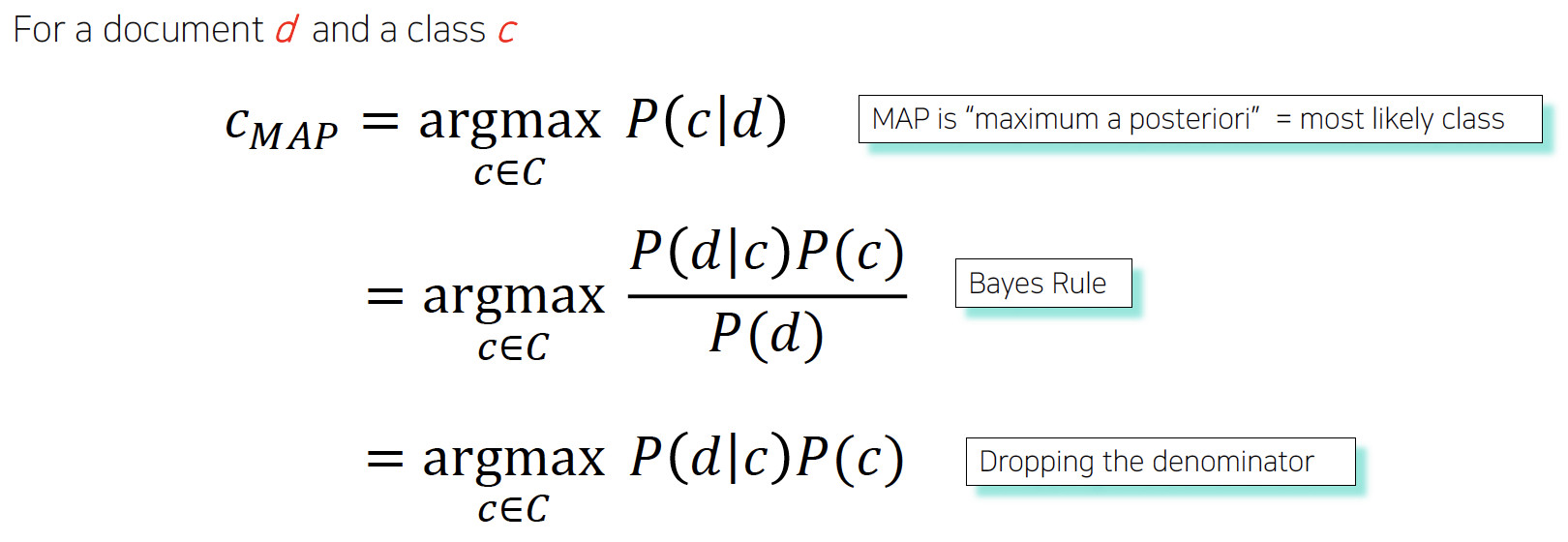

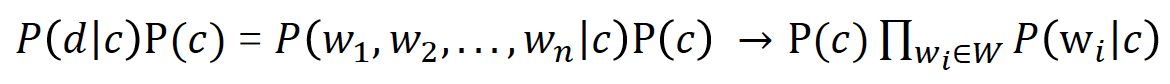

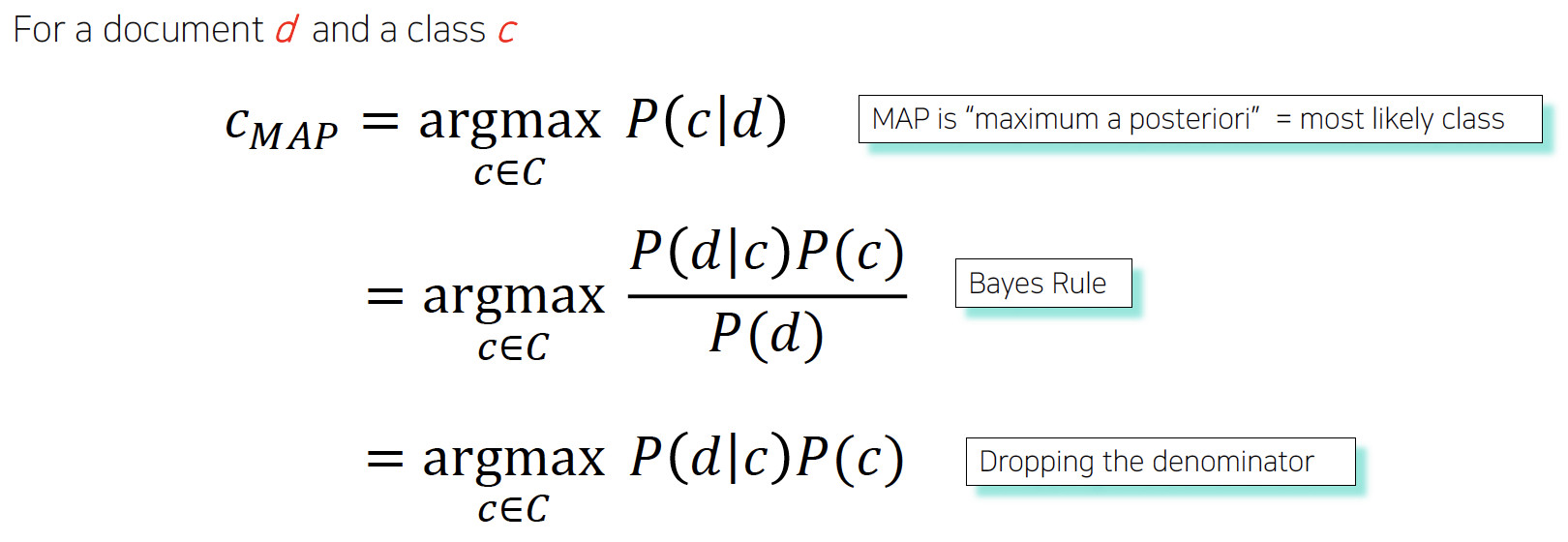

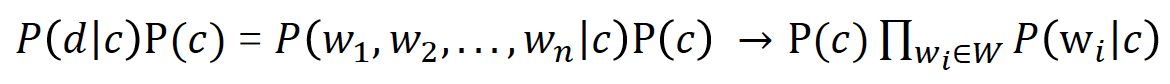

(conditional independence 가정)

1) Intro to Natural Language Processing(NLP)

- 자연어를 다루는 여러가지 분야

- Natural language processing (major conferences: ACL, EMNLP, NAACL)

- Text mining(major conferences: KDD, The WebConf (formerly, WWW), WSDM, CIKM, ICWSM)

- Information retrieval (major conferences: SIGIR, WSDM, CIKM, RecSys)

- NLP의 트렌드: Vector (Word2Vec, GloVe) → RNN (LSTM, GRU) → Transformer (attention)

2) Bag-of-Words

- Bag-of-Words 표현 방법

- unique한 단어들을 모아 사전(vocabulary) 구축

- 각 단어들을 one-hot vectors로 인코딩

- 문장(sentence)이나 문서(document)는 one-hot vectors의 합으로 표현할 수 있음

- Bayes' Rule

2. Word Embedding

더보기

1) Word2Vec

- Word Embedding: 단어를 벡터로 표현

- Word2Vec

- 각 단어들을 one-hot vector로 표현

- sliding window 기법 적용

- word vector: 단어 사이의 관계 나타냄

- CBOW, SkipGram

| CBOW | SkipGram |

|

|

- 사용 예시

- Analogy Reasoning: 단어들 간의 의미론적 관계 파악

- Intrusion Detection: 가장 상이한 단어 고르는 것

Korean Word2Vec

ABOUT 이곳은 단어의 효율적인 의미 추정 기법(Word2Vec 알고리즘)을 우리말에 적용해 본 실험 공간입니다. Word2Vec 알고리즘은 인공 신경망을 생성해 각각의 한국어 형태소를 1,000차원의 벡터 스페이

word2vec.kr

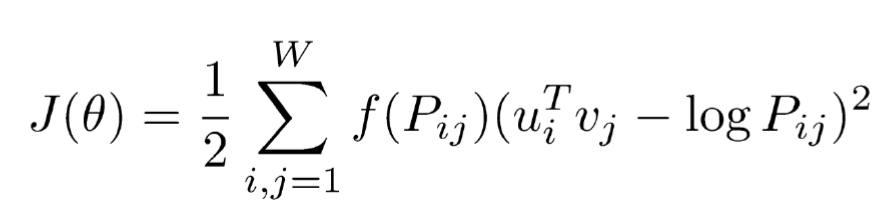

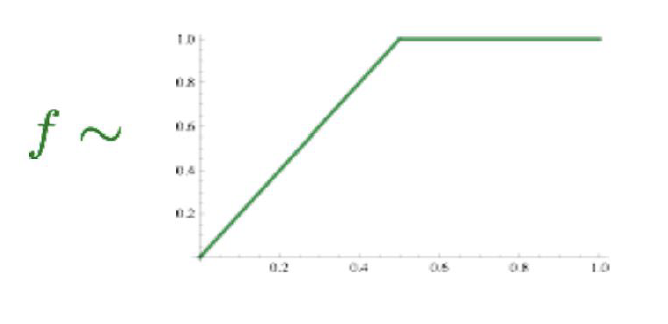

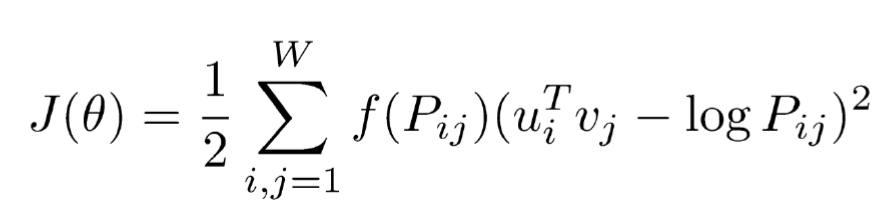

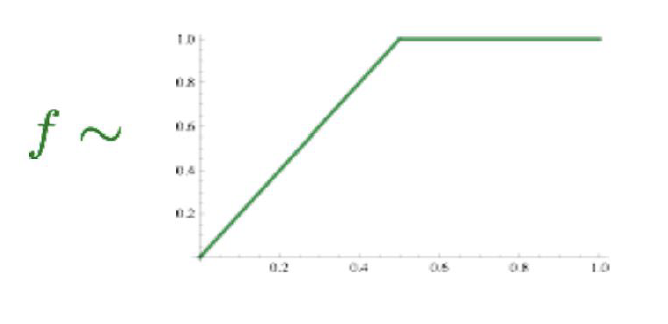

2) GloVe

- 동일한 단어 반복 방지 위해 co-occurrence matrix 계산

- 전체적인 정보 반영 가능

참고

임베딩 기법(Embedding)

본 글은 자연어 처리에서 주로 사용하는 임베딩 기법들에 대해 정리해놓은 자료입니다. One-hot Encoding, TF-IDF, LSA, Word2Vec, Glove, FastText에 대해 정리할 것이고 ratsgo님의 블로그을 많이 참고하였습니.

eda-ai-lab.tistory.com

코멘트

길었던 연휴가 끝나고 다시 바쁜 일정이 시작되었다. 연휴동안 PyTorch로 시작하는 딥러닝 입문을 보고 따라하면서 열심히 삽질을 했었는데 오늘 강의에 그 내용이 나와서 반가웠다.